Il y a un problème que personne n’anticipe vraiment quand on parle de l’astronomie moderne : ce n’est pas le manque de données qui freine la science. C’est l’excès. D’ici 2025, les observatoires seront capables de recevoir chaque jour l’équivalent de tout Internet en données brutes. Des téraoctets d’images, de spectres, de relevés infrarouges — que des équipes humaines, aussi brillantes soient-elles, ne pourront jamais analyser à la main. C’est dans ce contexte qu’une alliance inattendue est en train de se former : celle du télescope le plus puissant jamais construit, et de l’intelligence artificielle.

Ce que James Webb génère — et ce qu’on ne peut pas lire

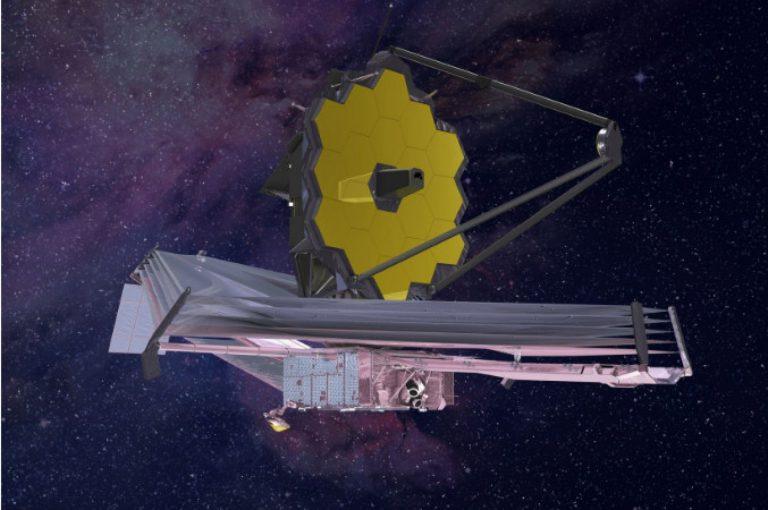

Le James Webb Space Telescope observe l’univers dans l’infrarouge proche et moyen. Ce choix technique n’est pas anodin : l’espace est en expansion, ce qui décale hors du spectre visible, dans l’infrarouge, la lumière qui a voyagé depuis l’époque présumée de la formation des premières étoiles et galaxies, plusieurs centaines de millions d’années après le Big Bang. Webb voit donc littéralement dans le passé de l’univers — mais chaque observation génère des images brutes noyées dans un bruit de fond considérable. Bruit thermique des détecteurs, interférences électroniques, rayonnement résiduel : avant même qu’un astronome puisse interpréter quoi que ce soit, les données doivent être nettoyées. Et c’est là que les algorithmes entrent en jeu.

Des algorithmes permettent d’appliquer divers traitements pour optimiser les réglages du JWST et corriger les sources de bruit dans l’image brute. Mais jusqu’à très récemment, ces outils restaient relativement conventionnels — des filtres statistiques, des techniques de superposition d’expositions. La rupture est venue d’ailleurs.

ASTERIS : voir ce qui était invisible

En février 2026, une équipe interdisciplinaire de la Tsinghua University a publié dans la revue Science les résultats d’un modèle d’IA baptisé ASTERIS — pour Astronomical Spatiotemporal Enhancement and Reconstruction for Image Synthesis. Le principe est élégant : plutôt que d’empiler des centaines d’expositions pour réduire le bruit — une méthode coûteuse en temps d’observation — ASTERIS reconstruit chaque image comme un volume tridimensionnel intégrant à la fois l’espace et le temps, pour distinguer les signaux réels des artefacts.

Le système améliore la sensibilité de détection d’environ une magnitude, soit une augmentation par dix de la capacité à détecter des objets faibles. En pratique, cela signifie que les télescopes peuvent voir des objets environ 2,5 fois plus faibles qu’avec les méthodes actuelles. Traduit autrement : avec le même temps d’observation, ASTERIS permet de voir ce qui était jusqu’ici invisible.

Les résultats sur les données du Webb sont frappants. L’équipe a identifié plus de 160 galaxies candidates de la période dite « Cosmic Dawn » — une époque située entre 200 et 500 millions d’années après le Big Bang — soit trois fois plus que ce que les méthodes précédentes permettaient de détecter. Le modèle peut identifier des galaxies situées à plus de 13 milliards d’années-lumière et générer les images les plus profondes de l’espace jamais produites.

La question du risque de faux positifs — des galaxies « hallucinées » par l’IA — a bien sûr été posée. L’équipe a multiplié les protocoles de vérification : injection de faux signaux pour tester la capacité de détection, entraînement sur des sous-ensembles de données, et confrontation systématique aux images réelles à longue exposition. Le résultat : la grande majorité des sources identifiées par ASTERIS correspondent à des objets réels confirmés par les observations profondes traditionnelles.

Un lycéen, 1,5 million d’objets, et 250 000 dollars

ASTERIS n’est pas un cas isolé. L’IA s’invite dans l’astronomie par toutes les portes, y compris les plus inattendues. En avril 2025, Matteo Paz, un lycéen de 18 ans de Pasadena en Californie, a remporté le premier prix du Regeneron Science Talent Search — 250 000 dollars — pour avoir développé un algorithme de machine learning capable d’analyser des données archivées du télescope NEOWISE de la NASA. Résultat : 1,5 million d’objets astronomiques potentiellement nouveaux, cachés dans des données que personne n’avait eu le temps d’examiner. L’IA n’a pas découvert l’espace — elle a lu ce que personne n’avait le temps de lire.

Ce que ça change pour la recherche de vie extraterrestre

Ce changement de paradigme a des implications directes sur les questions les plus fondamentales de l’astronomie — à commencer par la recherche de biosignatures. On en a eu un aperçu saisissant l’an dernier avec l’affaire K2-18b : l’équipe de Cambridge a utilisé la spectroscopie infrarouge de Webb pour tenter de détecter du diméthylsulfure dans l’atmosphère de cette exoplanète, une molécule associée sur Terre à des organismes vivants. Le débat scientifique qui a suivi a mis en lumière une limite criante : les données brutes de Webb contiennent trop de bruit pour trancher avec certitude. C’est exactement le problème qu’ASTERIS et ses successeurs sont conçus pour résoudre.

Les scientifiques spécialisés dans les exoplanètes pourraient ainsi caractériser les atmosphères de planètes plus petites, semblables à la Terre, en extrayant des signaux spectraux plus nets à partir de données bruitées. Autrement dit : la prochaine détection potentielle de vie extraterrestre ne dépendra peut-être pas seulement du télescope pointé vers le ciel, mais de l’algorithme chargé d’interpréter ce qu’il voit.

La prochaine génération voit déjà plus loin

Les chercheurs prévoient de déployer cette technologie sur les télescopes de prochaine génération pour répondre à des questions majeures concernant l’énergie noire, la matière noire, les origines cosmiques et les exoplanètes. Le Vera C. Rubin Observatory, dont les premières observations sont attendues cette année, sera capable de générer 20 téraoctets de données par nuit. Sans IA, ces données resteraient en grande partie inexploitées.

Ce qui est en train de se construire, c’est une nouvelle façon de faire de la science. L’astronome fixe toujours l’objectif, interprète les résultats, pose les questions. Mais entre le ciel et la découverte, il y a désormais une couche algorithmique qui voit ce que l’œil — et même le détecteur — ne peut pas voir seul. C’est peut-être la transformation la plus silencieuse et la plus profonde de l’astronomie depuis l’invention du télescope.

Rejoignez-nous sur Medium

Article rédigé le 19 mars 2026 par Adrien Hassler, passionné d’astronomie, d’IA et de nouvelles technologies, et créateur d’AdrienTech.com

Un commentaire

Les commentaires sont fermés.