Il y a une image qu’on a du mal à associer à un serveur informatique : celle d’une rivière qui baisse. Pourtant, c’est exactement ce que documentent de plus en plus de rapports sur les infrastructures numériques mondiales. La consommation des data centers en eau et en énergie est devenue l’une des questions les plus pressantes du numérique. Derrière chaque requête envoyée à un modèle d’IA, derrière chaque vidéo streamée, derrière chaque fichier stocké dans le cloud, se cache une réalité physique que l’immatérialité du numérique dissimule efficacement. Les data centers consomment de l’énergie en quantités industrielles. Et ils boivent.

Des chiffres qui donnent le vertige

L’ADEME recense 352 data centers en activité en France, pour une consommation électrique totale de 10 térawattheures par an — soit l’équivalent de l’électricité consommée par 9 à 10 agglomérations de plus de 100 000 habitants pendant un an. À l’échelle mondiale, la situation est encore plus saisissante. La consommation des data centers pourrait atteindre entre 620 et 1 050 TWh en 2026, ce qui représenterait une part comprise entre 2,1 % et 3,7 % de la consommation mondiale d’électricité — comparable à la consommation annuelle du Japon.

Le cas irlandais illustre à lui seul jusqu’où peut aller cette dépendance. Les data centers absorbaient déjà 17 % de l’électricité nationale irlandaise en 2022, contre moins de 5 % en 2015. Cette part pourrait monter à 30 % d’ici 2030 si aucune limitation n’est imposée. Un petit pays dont le réseau électrique est en train d’être progressivement capturé par des infrastructures que la plupart de ses habitants ne verront jamais.

Data centers : la consommation d’eau, le grand oublié

On parle beaucoup d’énergie. On parle peu d’eau. C’est pourtant l’autre face du problème, peut-être plus préoccupante encore à long terme. La question de la consommation des data centers en eau et en énergie se concentre précisément sur ce poste. Selon un article paru dans la revue scientifique Nature, un petit data center d’une puissance de 1 mégawatt utilise en moyenne 25,5 millions de litres d’eau par an pour ses besoins en refroidissement.

La mécanique est simple : les serveurs chauffent, il faut les refroidir, et le moyen le plus efficace reste encore l’évaporation de l’eau. Un data center standard nécessite environ 600 000 mètres cubes d’eau par an, soit l’équivalent de 6,5 piscines olympiques quotidiennement. Multiplié par les milliers d’installations réparties dans le monde, le total devient vertigineux. À l’échelle mondiale, la consommation totale des data centers a atteint 560 milliards de litres d’eau en 2023, d’après l’Agence internationale de l’énergie. Et cette institution anticipe une hausse spectaculaire dans les années à venir, avec un volume qui pourrait doubler pour atteindre 1 200 milliards de litres par an d’ici 2030.

L’IA comme accélérateur de la crise

Tout ce qui précède existait avant l’essor de l’IA générative. Mais cette dernière est en train de changer l’échelle du problème. Une requête sur ChatGPT consomme dix fois plus d’énergie qu’une simple recherche Google. Les data centers dédiés à l’IA affichent une consommation électrique 4 à 5 fois supérieure aux centres traditionnels.

Ce n’est pas une anecdote marginale. Le Rapport international sur la sûreté de l’IA avertit que, si la tendance se poursuit, les modèles d’IA à usage général pourraient nécessiter jusqu’à 100 fois plus de puissance de calcul d’ici fin 2026. En 2027, l’IA pourrait consommer autant d’eau que la moitié du Royaume-Uni, ou 4 à 6 Danemark.

Et les investissements massifs annoncés ces derniers mois ne vont pas dans le sens d’un ralentissement. Emmanuel Macron a annoncé en février 2025, lors du Sommet de l’IA, des investissements en France à hauteur de 109 milliards d’euros, notamment pour l’installation de nouveaux data centers. Amazon, Google et Microsoft prévoient à elles seules une hausse de 78 % du nombre de leurs centres de données. La dynamique est lancée, et personne ne semble prêt à appuyer sur le frein.

Ce que le refroidissement coûte vraiment

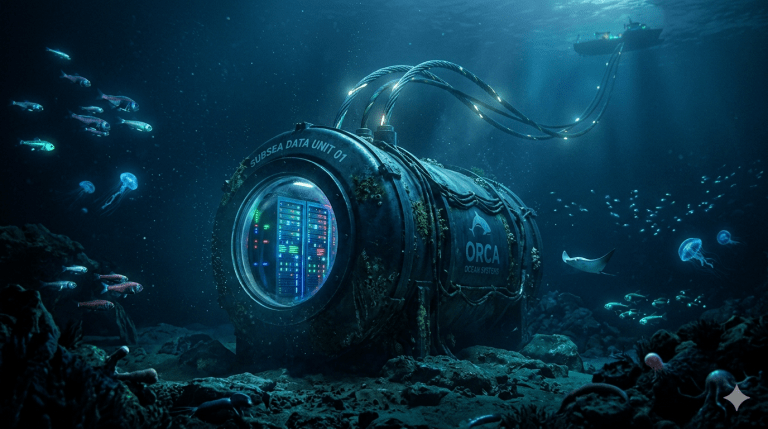

Le refroidissement représente entre 30 et 40 % de la facture énergétique d’un data center. C’est le poste le plus critique, et celui sur lequel les ingénieurs concentrent l’essentiel de leurs efforts d’optimisation. Plusieurs technologies coexistent aujourd’hui : le free cooling, qui utilise l’air extérieur dans les régions tempérées ; le refroidissement adiabatique, économe en énergie mais gourmand en eau ; et l’immersion cooling, qui consiste à plonger les serveurs directement dans un liquide diélectrique. Cette dernière méthode réduit la consommation énergétique de 48 %, mais reste encore marginale dans les déploiements à grande échelle.

L’IA elle-même commence à être mobilisée pour résoudre le problème qu’elle contribue à créer : le système DeepMind de Google a réduit la consommation énergétique de refroidissement de 40 % et amélioré l’efficacité énergétique globale de 15 %. C’est une ironie que les ingénieurs assument sans complexe.

La chaleur fatale, ressource ignorée

Il existe une piste moins médiatisée mais concrètement prometteuse : la récupération de la chaleur produite par les serveurs. L’ADEME estime à 3,6 TWh le potentiel de récupération lié aux data centers en France. Cette chaleur peut chauffer des bâtiments voisins, des piscines, des serres ou des hôpitaux. Environ 32 % des data centers français sont déjà reliés à des réseaux de chaleur urbains. Microsoft récupère 69 % de la chaleur produite, un taux qui monte à 86 % en été. Ce qui était un déchet devient une ressource — à condition qu’on ait pensé à construire les infrastructures pour l’acheminer.

Ce que les régulateurs commencent à exiger

La réglementation suit, lentement. En France, le dispositif éco-énergie tertiaire impose aux data centers de plus de 1000 m² une baisse de 40 % de leur consommation d’électricité à l’horizon 2030. À partir d’octobre 2025, les propriétaires et exploitants sont soumis à l’obligation de récupération et valorisation de la chaleur fatale pour les installations supérieures à 1 MW. Et la transition vers 100 % d’énergies renouvelables devient obligatoire en Europe dès 2027.

C’est un cadre qui se resserre. Mais les projections de l’ADEME restent préoccupantes : si rien n’est fait, la consommation électrique des centres de données pourrait être multipliée par 3,7 en France d’ici 2035.

Une question de choix collectif

Ce qui se joue derrière les chiffres des data centers, c’est une question qu’on pose rarement frontalement : voulons-nous vraiment de tout ce que l’IA nous propose, à n’importe quel prix ? On en a eu un aperçu avec le débat sur K2-18b — des algorithmes toujours plus puissants, entraînés sur des infrastructures toujours plus énergivores, pour tenter de lire des signaux dans des données astronomiques bruitées. La science y gagne peut-être. La planète, elle, présente la facture.

Les pouvoirs publics jouent un rôle clé. Ils peuvent encadrer le développement des data centers, fixer des normes, prioriser certains usages et intégrer ces infrastructures dans une planification énergétique et territoriale cohérente. Mais les entreprises et les usagers ont également un rôle. Chaque usage numérique a un coût physique. Ce n’est pas une raison de ne plus rien faire en ligne — c’est une raison de savoir ce qu’on fait, et pourquoi. La dette technologique des data centers en matière d’eau et d’énergie est désormais documentée, chiffrée, et opposable.

Rejoignez-nous sur Medium

Article rédigé le 19 mars 2026 par Adrien Hassler, passionné d’astronomie, d’IA et de nouvelles technologies, et créateur d’AdrienTech.com

3 commentaires

Les commentaires sont fermés.